毎日 ChatGPT や Claude に質問を投げ、生成された答えをそのまま受け取って仕事を進めている──そんな日々を送っていませんか? 私もそのひとりです。

この前ふと、本棚の奥にあった一冊を取り出してみました。新井紀子『AI vs. 教科書が読めない子どもたち』。2018年に刊行されてビジネス書大賞・紀伊國屋じんぶん大賞をダブル受賞、累計80万部を超えた話題作です。

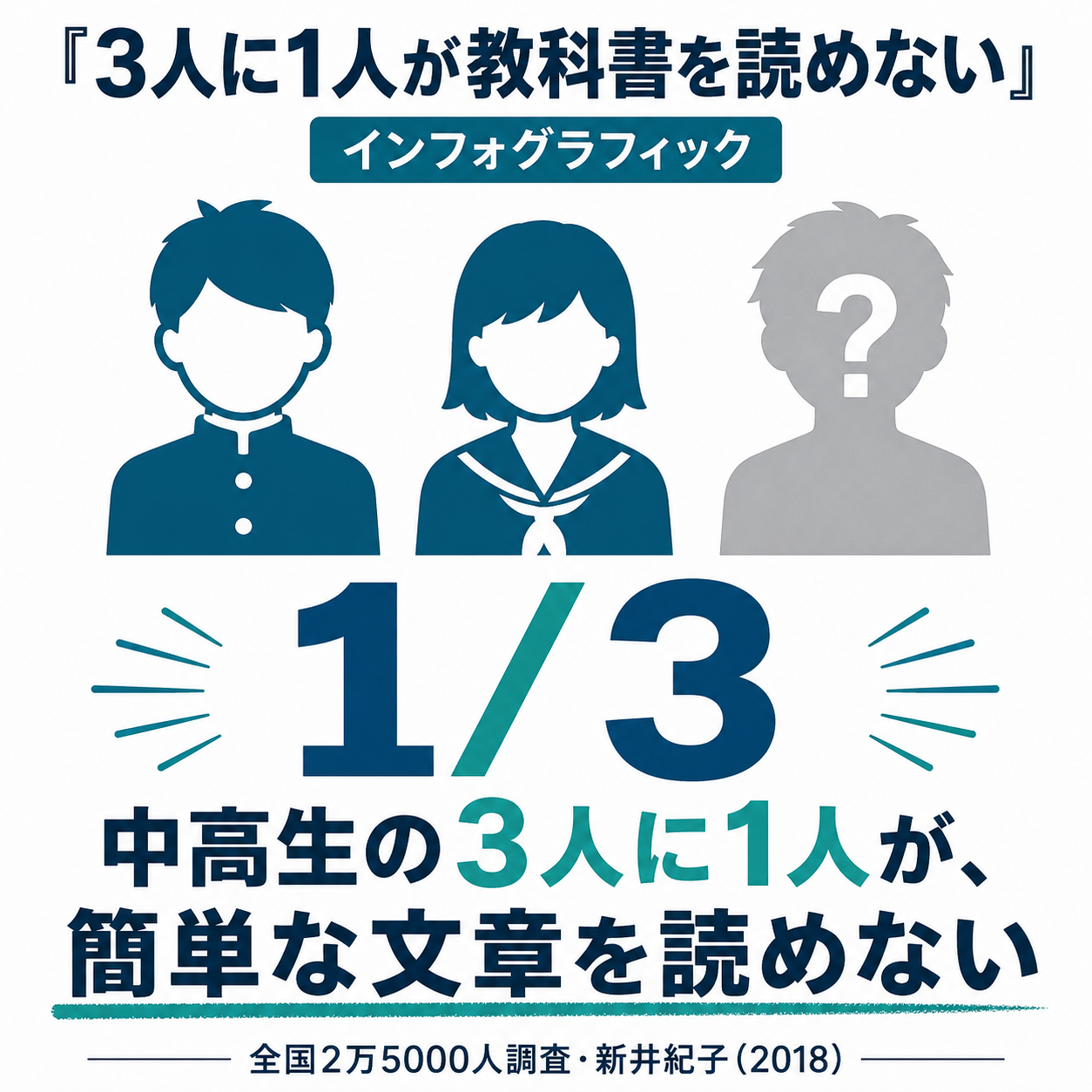

読んだ当時は「人工知能はすでにMARCH合格レベル」という衝撃的な帯のコピーや、「中高生の3人に1人が簡単な文章を読めない」という調査結果に、ただただ驚いた記憶があります。

それから8年。生成AIが当たり前の道具になった2026年に読み返してみると、当時の印象とまったく違う読み心地でした。古びた箇所もはっきりある。でも、それを差し引いてなお、警鐘の意味がむしろ重みを増している本だったのです。

かたてまポイント ── まずここだけ読んで

書籍の基本データ

| 書名 | AI vs. 教科書が読めない子どもたち |

| 著者 | 新井 紀子(国立情報学研究所 教授) |

| 出版社 | 東洋経済新報社 |

| 発売 | 2018年2月 |

| ページ数 | 約290ページ |

| 受賞 | ビジネス書大賞2019・大賞、紀伊國屋じんぶん大賞2019・大賞 |

| 読了時間の目安 | 約6〜8時間(章ごとに区切って読める) |

こんな人に向けて書いています

- 生成AIを毎日仕事で使っているけれど、出力の正誤を判断しきれずぼんやりした不安を感じている人

- 子どもや部下の読解力が気になっている保護者・教育関係者・マネージャー

- 「シンギュラリティは来るのか来ないのか」を、もう一度地に足をつけて考えたい人

- AI 関連の本は読んだけれど教育や労働市場の話までつなげて整理した本を読みたい人

- 8年前の話題作が今読む価値があるか、判断したい人

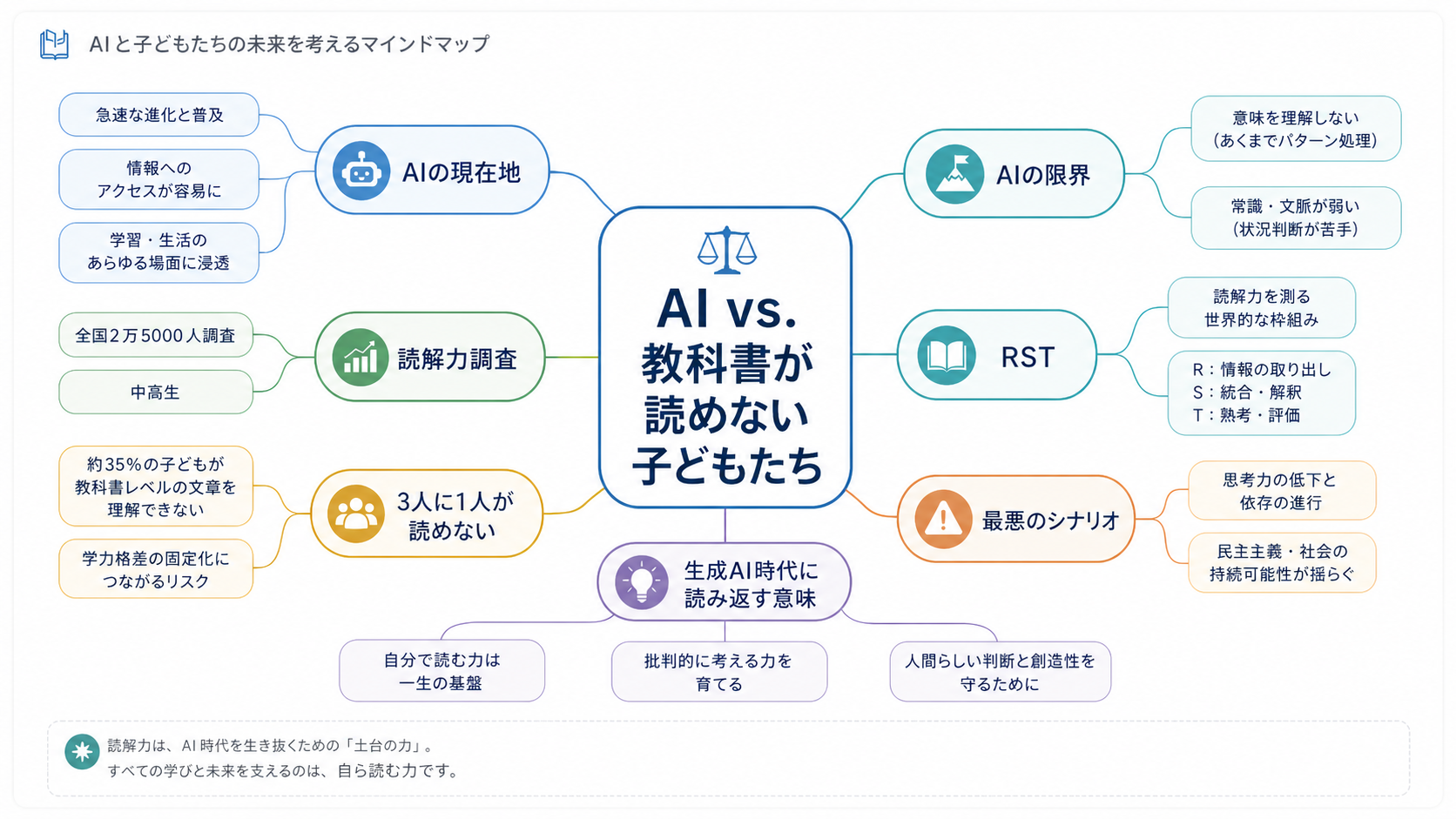

この本を一言で言うと

「AIに代替されない人材を育てる土台は、結局のところ『教科書が読める』ことだ」

数学者であり AI 研究者でもある著者が、東ロボくんプロジェクトと全国2万5000人の読解力調査から導き出した、シンプルだが重い結論。

かたてまひとこと: 2026年の今読むなら、第3章(読解力調査)と第4章(最悪のシナリオ)だけでも十分価値があります。第1〜2章のAI技術解説は当時の到達点を語った部分なので、生成AI時代の今は「歴史資料」として軽く読み流すのがおすすめ。

著者・書籍について

著者の新井紀子さんは、国立情報学研究所の教授で、専門は数理論理学。一般社団法人「教育のための科学研究所」の代表理事も務めています。

経歴がちょっと変わっていて、一橋大学法学部を経てイリノイ大学で数学を学び直し、博士(理学)を取得しています。法学から数学へ、というキャリアの曲がり方が、本書全体の「論理の言葉で社会問題を語る」スタイルに通じている気がします。

新井さんの代表的な仕事は二つ。ひとつは「ロボットは東大に入れるか」プロジェクト(東ロボくん)。2011年から2016年にかけて、AIで東大入試合格を目指したチャレンジです。もうひとつは、その過程で開発されたリーディングスキルテスト(RST)。文章を正確に読み解く力を6つの観点で診断するテストで、本書刊行時で2万5000人、2024年時点では延べ50万人以上が受検しています。

つまり本書は、「AIを作る側」と「AIに対峙する人間を育てる側」の両方を10年以上やってきた人が、その実体験から書いたレポートなんですね。

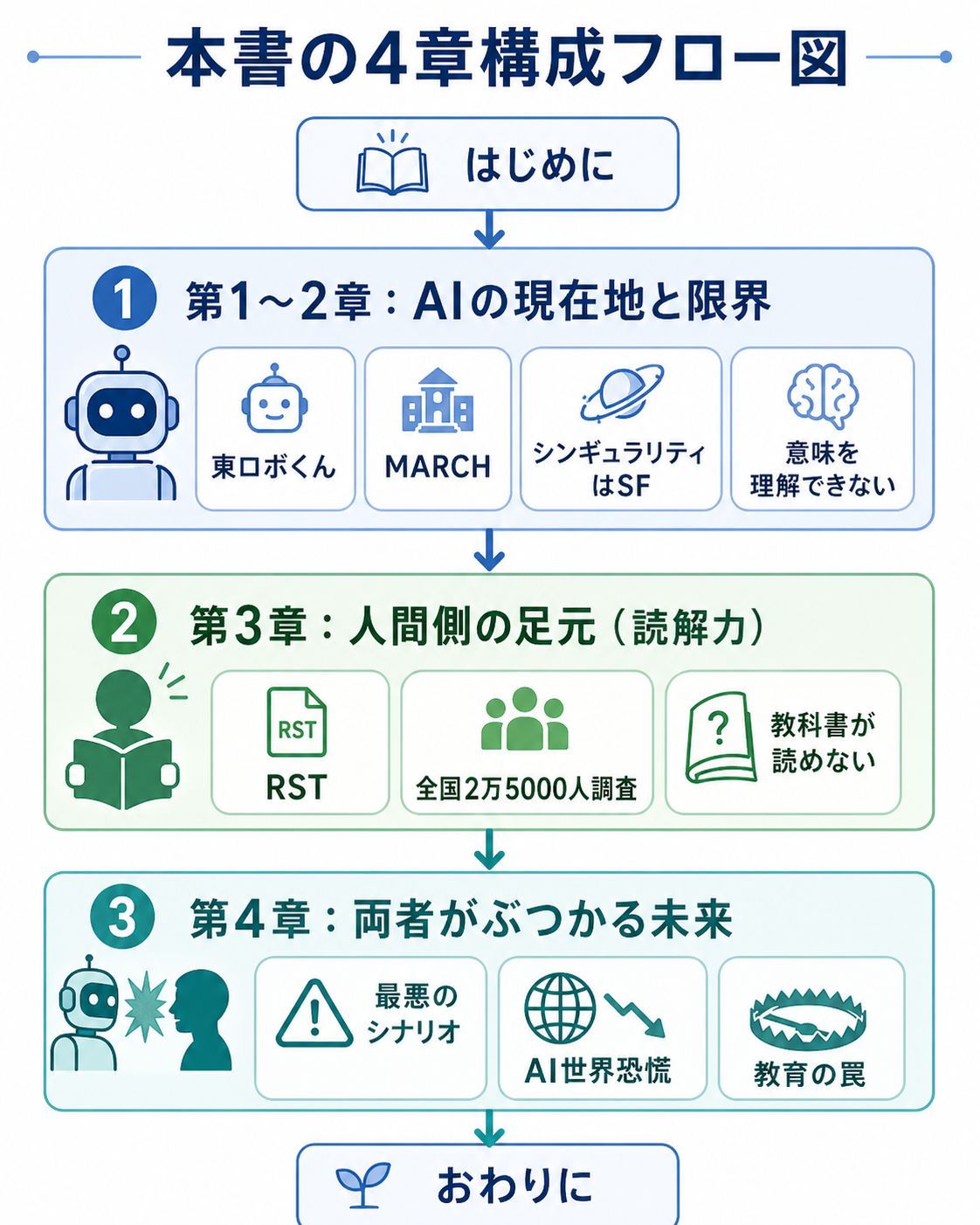

本書の流れ ── 4章構成

約290ページの本ですが、構成は驚くほどクリアです。

| 章 | タイトル | ざっくり何が書かれているか |

| はじめに | 私の未来予想図 | 「AIは神にも征服者にもならない/シンギュラリティは来ない/でもAI恐慌は来る」結論先出し |

| 第1章 | MARCHに合格 ── AIはライバル | 東ロボくんプロジェクトの軌跡。AI進化の歴史と現在の到達点 |

| 第2章 | 桜散る ── シンギュラリティはSF | 東大には受からなかった。AIは「意味」を理解できないから |

| 第3章 | 教科書が読めない ── 全国読解力調査 | RST 開発と全国2万5000人調査。3人に1人が教科書を読めていない |

| 第4章 | 最悪のシナリオ | AIに代替できる人材を育ててきた教育の罠と、AI世界恐慌のシナリオ |

| おわりに | (結語) | 中学1年生全員へのRST無償提供という、著者の最終目標 |

第1〜2章でAIの現在地と限界を整理し、第3章で人間側の足元(読解力)を直視し、第4章で両者がぶつかる未来を描く。AI論と教育論を1本の線でつないだ構成が、本書の評価が高い理由のひとつだと思います。

読む前に、ちょっと自分に問いかけてみる

本書を読み始める前に、よかったら以下の3つの問いを自分に投げかけてみてください。全部の答えがすぐに出る必要はありません。引っかかる問いほど、本書を読み終えたあとに自分の中で景色が変わるはずです。

問い1:直近1週間で生成AIの出力を「読み直して訂正した」ことが何回ありますか?

ゼロ回だとしたら、それはAIの精度が高いからではなく、自分が出力をちゃんと読めていないサインかもしれません。本書の問題提起の入口はここです。

問い2:自分の読解力に「自信あり」と即答できますか?

本書の調査では、調査結果を見せられた多くの社会人が「自分は大丈夫」と答えたそうです。しかし、その自信の根拠を本気で問われると、答えに詰まる人がほとんど。「自分は読める」という前提が、本書を読むときに一度揺さぶられるはずです。

問い3:AIに置き換えられない仕事とは、どんな仕事だと思いますか?

「クリエイティブな仕事」「人と関わる仕事」と答えがちですが、本書はその答えの詰めの甘さを容赦なく指摘します。何が「AIに置き換えられない仕事」の本当の条件なのか、本書を読み終わった後にもう一度考えてみてください。

印象に残った3つのポイント

1. AIは「意味」を理解できない ── 数学の限界

本書の理論的な核は第2章にあります。著者は数理論理学の専門家として、こう断言します。

AIがコンピューター上で実現されるソフトウェアである限り、人間の知的活動のすべてが数式で表現できなければ、AIが人間に取って代わることはありません。

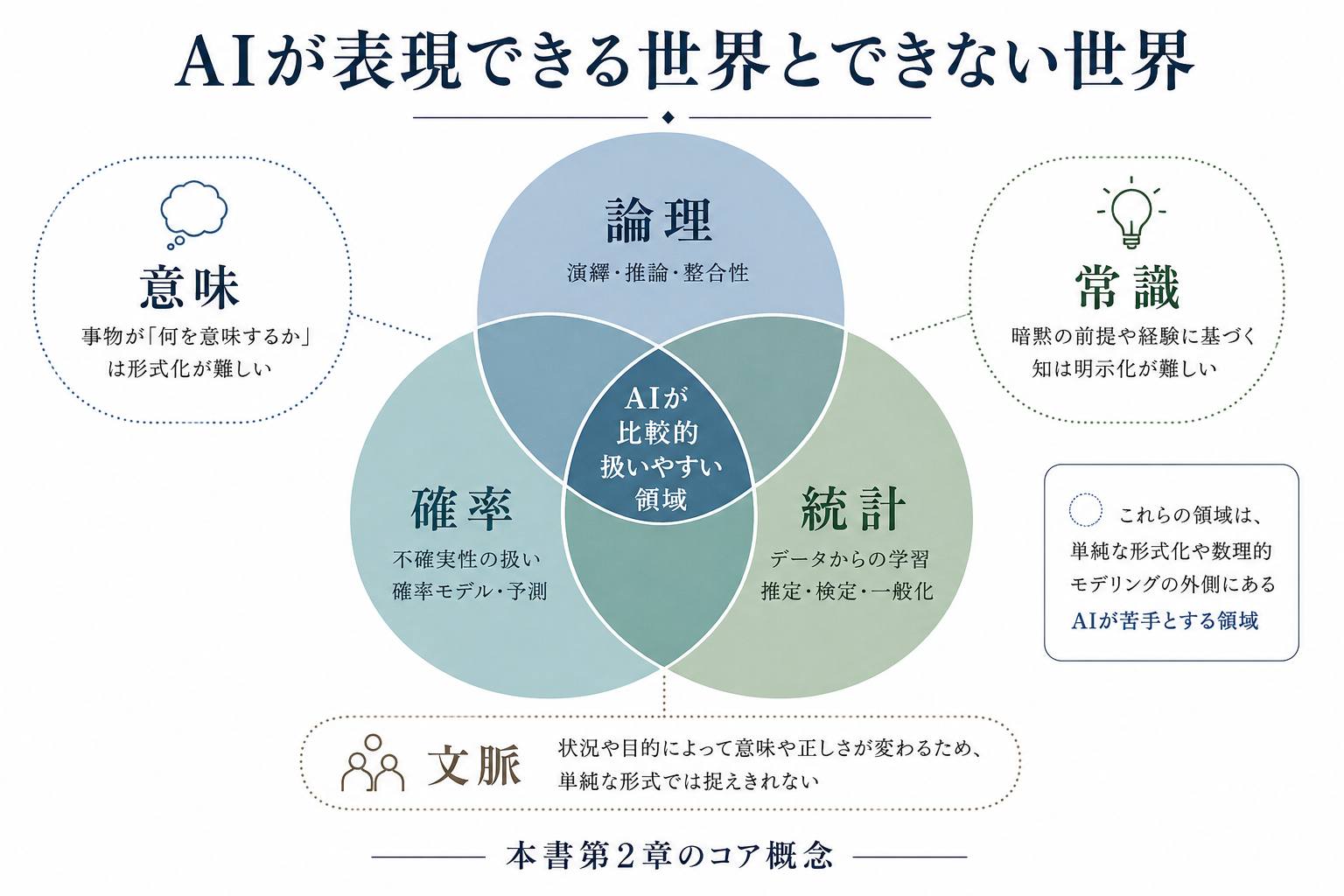

数学が世界を表現できる言葉は、論理・確率・統計の3つだけ。この3つの言葉で表せないものは、AIには扱えない──これが本書を貫く論理です。

例として挙げられているのが、機械翻訳の失敗例。「私は先週、山口と広島に行った」という日本語を、当時の機械翻訳は 「I went to Yamaguchi and Hiroshima last week」 と訳すのが難しかった。なぜなら、「山口」が地名なのか人名なのかを判定するには、文脈と常識が必要だからです。AIには、その「文脈」と「常識」が原理的に持てない、と著者は論じます。

2026年の補足:

ここは本書のなかで最も再評価が必要なパートです。2026年の生成AIは、上の例文くらいなら何の問題もなく訳します。DeepLやGPT、Claudeの翻訳精度は、もはや実務で日常的に使えるレベル。

ただし、著者の指摘の本質は今も生きています。「LLMは膨大な文章パターンから最尤系列を出力しているだけで、意味を本当に理解しているかは別問題」という議論は、Stochastic Parrot 論争として現在も学術界で続いています。生成AIが平気で嘘をつくハルシネーション現象こそ、「意味を理解していない」ことの傍証だ、と読むこともできます。

2. 中高生の3人に1人は教科書が読めない ── RSTの衝撃

本書のいちばんの読みどころが、第3章の全国読解力調査です。著者は東ロボくんが詰まった「読解力の壁」を逆手にとり、人間側の読解力を測るテスト(RST)を自ら開発します。

RSTは6つの観点で文章理解力を測ります。

| 領域 | 何を測るか | 例題のイメージ |

| 係り受け解析 | 主語と述語、修飾関係 | 「天の川銀河の中心にあるのは( )」の正解選択 |

| 照応解決 | 代名詞・指示詞の指す先 | 「Alexandra の愛称は何か?」 |

| 同義文判定 | 2つの文が同じ意味か | 「幕府はポルトガル人を追放した」≡「ポルトガル人は幕府によって追放された」 |

| 推論 | 論理的に導けるか | 与えられた文から結論が導けるか |

| イメージ同定 | 文と図表の対応 | 「四角の中に黒い円がある」を表す図はどれか |

| 具体例同定 | 抽象概念と具体例の対応 | 定義文に合う具体例の選択 |

そして全国2万5000人を調査した結果、「3人に1人が、簡単な文章を読めていない」という結論が出ます。

特に印象的なのが「Alexandra の愛称は?」問題。中学生の62%、高校生の72%が誤答だったといいます(4択でランダム正答率は25%ですから、ほぼ「読まずに選んでいる」レベル)。

著者の絶望に近い記述が、こう続きます。

解答用紙を見て採点をすれば、受検者が真面目に書いたかどうか、概ね判断できます……大半の学生は真面目に取り組んだと判断できます。

つまり、これは「やる気がない」のではなく、本当に読めていないという結論なんですね。

2026年の補足:

ここで興味深い反転が起きています。2024年に、ある検証実験が行われました。RSTの問題をClaude / GPT-4 / Gemini / Perplexity に解かせたところ、Claudeが正答率トップで、人間の中高生平均を大きく上回るスコアを出したのです。

つまり、本書執筆時は「AIには絶対に解けない」と想定されていた RST 問題を、今の生成AIは普通に解ける。本書の「AIにはここまで読めない」という前提は、すでに更新されています。

しかし、これは本書の価値を損なうものではありません。むしろ、「人間が AI より読めない」という構図が、より鮮明になったわけです。本書の警鐘は、当時より2倍重くなって響いてきます。

3. AIに分断されるホワイトカラー ── 最悪のシナリオ

第4章は本書のなかで最も現実味の濃い章です。著者の予測はこうです。

巷間にはAI失業者や最低賃金の仕事を掛け持ちする人々が溢れている。結果、経済はAI恐慌の嵐に晒される。

著者の論理はシンプルで、「現代日本の労働力の質は、AIのそれと似ている」から、AIで代替できない新しい仕事が生まれても、そこにスムーズに移れる人が少ない、というものです。AIが苦手な仕事(介護・畔の草抜き・コミュニケーション・柔軟な判断)は、読解力や常識を欠いたままの人にも苦手。だから労働市場で大量失業が起きる、というシナリオです。

2026年の補足:

このシナリオは、当たりつつあります。

翻訳業、コーディング業、カスタマーサポート、ライティング、カスタマーサクセスなど、ホワイトカラーの中核業務で、人員削減や採用抑制のニュースが2024年以降ずっと続いています。生成AIで代替できるタスクと、できないタスクの境界が動き続けるなかで、「AIを使いこなせる人」と「使いこなせない人」の二極化が、目に見える形で進行しています。

著者の予言は「方向としては正しく、想定よりスピードが速かった」というのが2026年時点の率直な評価だと思います。

本書への批判と、生成AI時代の検証

8年読み継がれてきた本書には、当然ながら批判もあります。せっかくなので主だったものを整理しつつ、2026年の視点でどう答えられるかを考えてみます。

批判1:「AIは絶対に意味を理解できない」と断定しすぎではないか

著者は数理論理学者として「コンピュータには意味理解は原理的に不可能」と強く言い切ります。これに対して、自然言語処理の研究者の中には「『意味理解』の定義による」「Embeddingによる意味の数値表現は十分『理解』と呼べる」と異を唱える人もいます。

2026年の検証: この論点は、LLM の Stochastic Parrot 論争として現役で続いています。生成AIが「ハルシネーションを起こす=事実関係を取り違える」のは、確かに「意味を理解していない」傍証にも見える一方、複雑な推論タスクで人間並みの精度を出すケースも増えています。著者の断定は強すぎるかもしれないが、警鐘としての価値は依然有効、というのが2026年時点の落としどころのように思います。

批判2:RSTの6パターンで読解力の全体像を測れるのか

リーディングスキルテストは「係り受け」「照応」「同義文判定」「推論」「イメージ同定」「具体例同定」の6領域で構成されますが、これだけで人間の読解力すべてを測定できるのかという指摘もあります。たとえば、文脈の推察力や行間の読み、皮肉や比喩の理解は本テストでは測れません。

2026年の検証: これはもっともな批判です。ただし、本書がターゲットにしているのは「教科書を正しく読めるか」という、文学的読解よりも一段下の基礎の基礎。ここですら3人に1人が落ちる、という事実のほうが本書のメッセージの中心であり、この批判は本書の射程を超えた要求かもしれません。

批判3:アクティブ・ラーニング推進派からの反論

著者は「アクティブ・ラーニングは絵に描いた餅」と一刀両断しますが、これは教育界では強い議論を呼んだ部分です。「読解力という土台がないアクティブ・ラーニングは空回りする」という著者の立場と、「アクティブ・ラーニングのなかで読解力も育つ」という現場の立場の対立がありました。

2026年の検証: ここは現在も続いている教育論争です。生成AIが教育現場に浸透してきた今、「AI を使った調べ学習」が読解力という土台抜きで成立するかが新しい問いになっています。著者の主張は、形を変えてまだ生きている問題提起だと思います。

このように、本書の主張は8年経って一部更新が必要になったところもあれば、当時の批判が今も有効だったり、逆に今のほうが的を射て見える部分もあります。「読み返すたびに評価軸が変わる」のが本書のおもしろさでもあります。

2026年の今、本書はどう読み直せるか

ここまで各ポイントで「2026年の補足」を入れてきましたが、最後に本書全体を生成AI時代の視点から整理してみます。これがこの書評のいちばん書きたかったパートです。

8年で「古びた」ところ

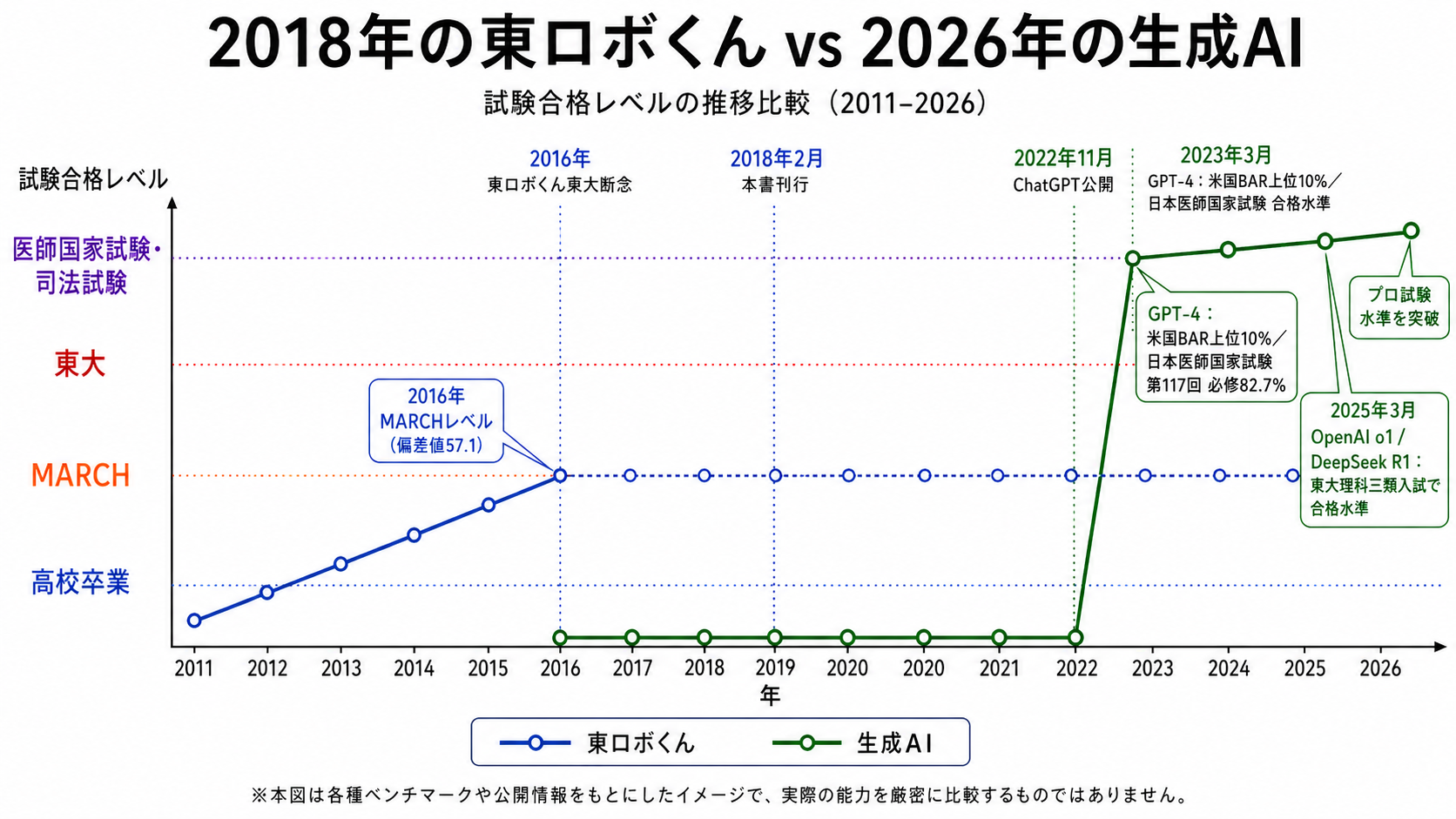

帯の「人工知能はすでにMARCH合格レベル」は、もう過去の風景です。2026年現在、生成AIは東大入試の類題を解き、司法試験・医師国家試験・米国の弁護士試験 BAR で合格レベルのスコアを叩き出しています。

本書の核心主張のひとつ、「東大には受からない(読解力の壁があるから)」自体が、すでに覆されています。「AIには絶対に解けない」とされたRST問題も、生成AIは解ける。本書執筆時から8年で、AI側の読解力は劇的に向上しました。

ただ、ここを「だから本書は時代遅れ」と切り捨てるのは早計です。著者自身、本書の前作『コンピュータが仕事を奪う』を含めて、AIの進化スピードを過小評価することの危険は何度も警告しています。本書を「2018年時点での精度の高い記録」として読めば、価値はむしろ上がります。

それでも色褪せない普遍

本書のメッセージで、2026年にむしろ強まっている部分があります。

(1) 読解力こそ AI 時代の最強スキル

生成AIを「使う側」に立つには、出力が正しいかどうかを判定する力が要ります。ハルシネーション(もっともらしい嘘)を見抜くには、結局のところRSTで測るような「同義文判定」「推論」の力が必要です。AIに丸投げできる仕事ほど、AIに置き換えられる──この法則を逆に読めば、AIの出力を読み、評価できる人だけが生き残るということになります。

(2) AI の出力を「読む」力こそ差別化要因

これは本書の射程を少し越えますが、生成AIの普及によって、コンテンツを生成する力よりも、生成されたものを評価する力のほうが希少になりつつあります。その評価の最も基本的な道具が、「教科書を読む力」とほぼ同じものなんですね。

(3) 教育の根本的問題

本書が指摘する「アクティブ・ラーニングは絵に描いた餅」「プログラミング教育より読解力」という主張は、AI時代でも普遍的に有効です。AIでレポートを「書ける」ようになっても、AIの出力を評価できる読解力がないと、結局はAIに振り回されるだけ──これは大人の仕事でも同じことが言えます。

著者の警鐘は的中しつつある

「おわりに」で著者は、データサイエンティストのキャシー・オニール『あなたを支配し、社会を破壊する、AI・ビッグデータの罠』を引用しています。「ビッグデータと AI への盲信は危険」というメッセージです。

2026年の今、AI ガバナンス、AI 倫理、生成AIの著作権問題、採用 AI のバイアス、自動運転の責任問題……これらは社会の最重要トピックになりました。本書「おわりに」の問題意識は、完全に時代の中心に来ています。

読んでどう感じたか ── 「読める」が新しい教養になる時代

本書を再読して、いちばん残ったのは「読める」ことの値段が上がったという感覚でした。

8年前、本書を初めて読んだ多くの人は、たぶん「中高生の読解力低下」「AIによる失業」を遠い社会問題として受け取ったと思います。「3人に1人が読めない」と言われても、自分はその「3人のうちの1人」ではない側だと、なんとなく信じていた。

でも、生成AIが当たり前になった2026年に再読すると、印象がまったく違います。

自分自身が、AIの出力をどれだけ「読めて」いるか──これがそのまま、生成AI時代の自分の市場価値を決める指標になりつつあるのです。AIの出力は、もっともらしい嘘を平気で混ぜてきます。引用元が架空だったり、論理に飛躍があったり、データの解釈が間違っていたり。それを見抜けるかどうかが、AIに使われる側で終わるか、AIを使いこなす側に立てるかの分かれ目になります。

新井さんが本書で測ろうとした「教科書が読める力」は、結局のところ、生成AIの出力を読み解く力そのものでもあります。本書が「AI vs 子どもたち」という構図で書かれた問題は、8年経って「AI vs すべての大人」という構図に拡張されたといえるのかもしれません。

「読解力」というと、なんとなく学校の国語のテストの話のように響きますが、2026年の視点で読み直すと、これはビジネスパーソンの新しい教養だという見方ができます。本書のメッセージは、教育論を超えて、働くすべての人への警鐘として響いてきます。

どうビジネス・学びに活かせるか

応用1:自分のRST的読解力を一度測ってみる

本書を読んで「自分は大丈夫だろうか」と少しでも引っかかったら、教育のための科学研究所が提供するシン読解力テスト(RST 公開版)を一度受けてみるのがおすすめです。AIに振り回されない第一歩は、まず自分の現在地を知ることから。

応用2:AIの出力を必ず「読み返す」習慣を作る

生成AIの出力を受け取ったら、最低でも1回は読み返して、矛盾や事実誤認がないかをチェックする。これだけで、AIに振り回される側から、AIを使いこなす側へとポジションが変わります。本書の警鐘を「自分ごと」として実装するなら、ここが起点です。

応用3:教育・採用の中心に「読解力」を置き直す

子どもの教育でも、部下の評価でも、採用面接でも、「この人は文章を正確に読めるか」を最重要指標のひとつに据える。新井さんの提案する社会変革を、自分の半径3メートルで実践する応用です。読解力は何歳からでも鍛えられる、というのが著者のメッセージでもあります。

次に読むなら、この3冊

『AI vs. 教科書が読めない子どもたち』を読み終えたあとの、自然な次の一歩として3冊選びました。逆に、「明日からすぐ使える生成AIプロンプト集が欲しい」という人には、本書はやや遠回りに感じるかもしれません。本書はAI時代のOS(基盤)をアップデートするための本で、テクニック集ではないからです。

1. 新井紀子『AIに負けない子どもを育てる』(2019年・東洋経済新報社)

本書の続編・実践編。まずこれを読みたい1冊。

本書で問題提起された「読解力をどう伸ばすか」を、具体的な授業実践例・家庭での取り組み・RST の使い方として体系化しています。本書が問題提起の書だとすれば、こちらは処方箋の書。親子で取り組めるドリル要素もあるので、子育て中の方には特におすすめ。

2. キャシー・オニール『あなたを支配し、社会を破壊する、AI・ビッグデータの罠』(2018年・インターシフト)

本書「おわりに」で著者が引用している、AI 倫理の現代古典。

ハーバード→MITで数学を修めた著者が、ウォール街でのデータサイエンティスト経験から、「客観的で正確だ」と信じられているアルゴリズムの欺瞞を告発します。採用 AI のバイアス、信用スコアの差別、教師評価アルゴリズムの暴走──2026年の AI ガバナンス議論の出発点になっている本です。新井さんと並べて読むと、AI 時代の人間の立ち位置が立体的に見えてきます。

3. 新井紀子『コンピュータが仕事を奪う』(2010年・日本経済新聞出版社)

本書の前作。著者のAI観・労働観の出発点。

本書よりも早い段階から、新井さんは「AIによる仕事の代替」という主題に取り組んでいました。当時の機械学習・ビッグデータの動向を踏まえつつ、すでに本書の中核議論の原型が示されています。本書を読んで著者の思考の流れに興味を持ったら、源流をたどる旅としてどうぞ。

まとめ ── 3つのポイントを再掲

| ポイント | 内容 | 2026年の今読むと |

| AIは意味を理解できない | 論理・確率・統計でしか動けない計算機械の限界 | 生成AIの流暢さの裏にあるハルシネーションを見抜く視点として、依然有効 |

| 3人に1人が教科書を読めない | 全国2万5000人のRST調査が示した日本の足元 | 生成AIが RST を解ける今、人間側の読解力低下はより深刻な問題に |

| AIに分断されるホワイトカラー | AIで代替できる人材を育ててきた教育の罠 | 著者の予測通り、二極化は現実進行中 |

帯の「MARCH合格レベル」というキャッチは、確かに2026年の生成AIの実力からすれば古い表現です。けれど、本書の本当の核心は「AIに振り回されない人間を育てる土台は読解力だ」というメッセージのほう。そしてそれは、生成AIが日常になった今、むしろ前より大事になっています。

8年前にベストセラーになった本書を、今もう一度手に取る価値は、十分にあります。

最終更新: 2026年4月 / 出典: 新井紀子『AI vs. 教科書が読めない子どもたち』(東洋経済新報社, 2018年)